研究

圖像生成模型邁向通用人工智慧之路

摘要

「GPT-Image-2」等圖像生成模型正持續推動多樣化的創意應用,展現其在教育、流行文化、資訊圖表乃至程式開發上的強大潛力。文章強調,具備多模態語音與視覺生成能力的模型,對於實現通用人工智慧(AGI)至關重要,而非僅限於文字與程式碼生成。此外,新聞也涵蓋了OpenAI的策略調整、GPT-5.5的效能評測,以及中國AI實驗室在開源模型與代理(Agent)領域的積極進展。

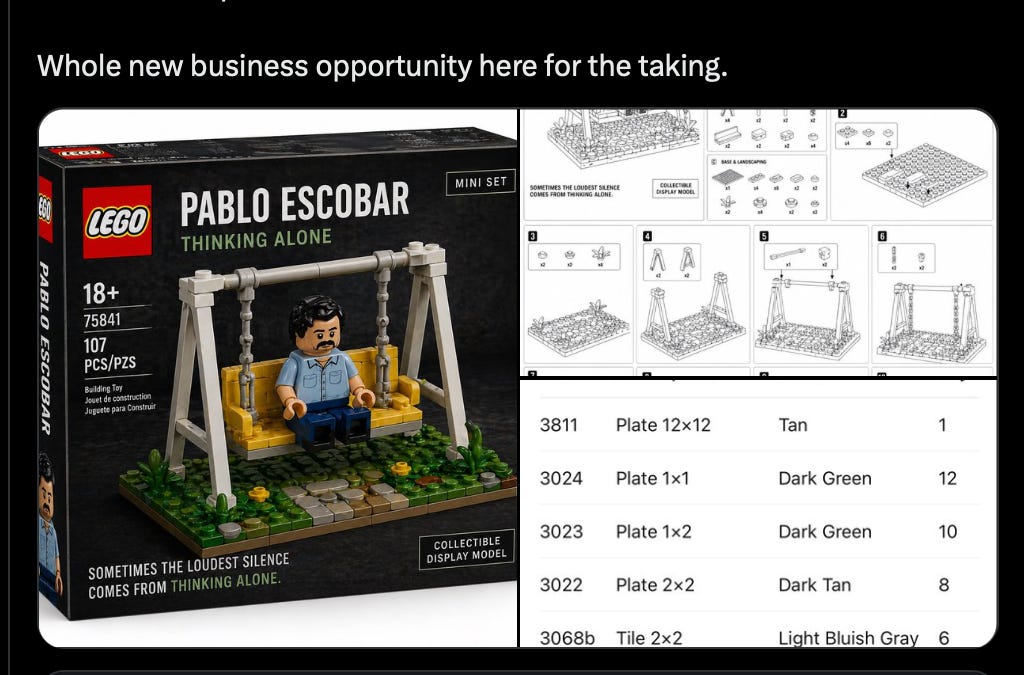

當各個實驗室都競相轉型為Anthropic模式(即專注於程式編碼和企業AI,產出更優質的PDF、PPT和試算表)時,看到GPT-Image-2持續推動更多創意應用,仍令人耳目一新,例如:

考量到Lego Rocky Space Friend在約會之夜極高的NPS分數,你可以想像一個低幻覺、具備研究能力、完全多模態推理的圖像模型會有多麼出色。

當然,它對教育也很有幫助:

或是流行文化:

或是精確、清晰的資訊圖表:

當然還有GPT-Image-2與Codex的組合,它作為Codex的一項技能,讓你在編寫程式碼的同時,可以迭代地生成各種素材:

就這樣,先前備受矚目的Claude Design,如今已不再是話題焦點。很簡單,如果你能「閉合」迴圈,你就能贏。

但這並非我們在此要提出的主要論點。我們真正關注的是一個非常實際且嚴肅的問題:如果我們放棄「支線任務」,認真追求AGI,並努力達成收入、效率和資金目標以避免中途夭折,那麼像Nano Banana、GPT-Image-2或Grok Imagine這樣的模型,是否仍是稀缺GPU資源的必要用途?

答案正逐漸明朗:是的。這不僅僅是因為「閉合迴圈」的能力,更是因為僅憑文字、程式碼和結構化輸出生成所能做到的事情有限。當你擁有多模態的語音和視覺生成(包括透明度!)能力時,你才能真正展現AGI中「通用(G)」的精髓——畢竟,如果AI只能狹隘地取代所有程式設計工作,那又有何用?

順帶一提,在圖像生成領域,過去「騎馬的太空人」很難生成,後來是「騎太空人的馬」,而現在,嗯……

2026年4月26日至27日的AI新聞。我們查閱了12個Reddit社群、544個Twitter帳號,但沒有更多Discord資訊。AINews的網站允許您搜尋所有過往議題。提醒您,AINews現已成為Latent Space的一個專區。您可以選擇訂閱或取消訂閱電子郵件頻率!

---

**AI Twitter 回顧**

**OpenAI 分發策略轉變、GPT-5.5 基準測試與 Codex/Copilot 定價信號**

**OpenAI 放寬 Azure 獨家協議**:@sama表示,OpenAI更新了與Microsoft的合作夥伴關係,Microsoft仍將是主要雲端供應商,但OpenAI現在可以將產品推向所有雲端平台,產品/模型承諾將延長至2032年,營收分成則到2030年。@scaling01和@kimmonismus迅速推斷出其含義:OpenAI現在可以透過Google TPU / AWS Trainium / Bedrock進行分發,而Microsoft對OpenAI智慧財產權的授權也將變為非獨家。@ajassy證實,OpenAI模型將在未來幾週內登陸AWS Bedrock。@simonw指出,新條款可能意味著舊的AGI條款實際上已失效。

**GPT-5.5 全面升級,但並非完全主導**:@htihle的社群評估顯示,GPT-5.5在WeirdML的「無思考」模式下達到67.1%,高於GPT-5.4的57.4%,但仍落後於Opus 4.7的76.4%,且後者使用的token更少。LMSYS Arena的結果顯示,GPT-5.5在程式碼競技場排名第9,文件處理第6,文字處理第7,數學第3,搜尋第2,視覺第5,並在專家競技場排名第5。Arena也澄清,目前的評估涵蓋中/高階推理,而極高階推理仍在等待中。@gdb對GPU核心等困難程式編碼任務給予了正面回饋,但@htihle也報告了在「無思考」模式下出現「壓縮CoT洩漏」/格式錯誤輸出的情況。

**開發者經濟模式日益明確**:GitHub宣布Copilot將於6月1日轉為按用量計費,這是一個顯著的轉變,因為代理(agentic)工作流程會消耗更多的執行時間。與此同時,@Hangsiin記錄了Codex的使用倍數:GPT-5.4 fast = 2倍,GPT-5.5 fast = 2.5倍,而5.4-mini和GPT-5.3-Codex則便宜許多。@sama認為Codex每月20美元仍具強大價值。OpenAI還透過@OpenAIDevs開源了Symphony,這是一個協調層,用於將問題追蹤器連接到Codex代理,實現「開啟問題 → 代理處理 → 提交PR → 人工審查」的工作流程。

**小米 MiMo-V2.5、Kimi K2.6 與中國以代理為導向的開源模型推動**

**MiMo-V2.5 是當日最大規模的開源發布之一**:@XiaomiMiMo在MIT授權下開源了MiMo‑V2.5-Pro和MiMo‑V2.5,兩者都具備100萬token的上下文長度。Pro模型被定位為複雜的代理/程式編碼模型,而較小的模型則為原生全模態代理。@eliebakouch的社群摘要提供了有用的技術細節:MiMo‑V2.5-Pro總參數約為1兆(1T)/420億(42B)活躍參數,使用FP8格式在27兆(27T)token上進行訓練;而MiMo‑V2.5總參數約為3100億(310B)/150億(15B)活躍參數,在48兆(48T)token上訓練,採用積極的交錯式SWA/全域注意力機制且無共享專家。小米還透過@_LuoFuli宣布為開發者提供100兆token的補助。vLLM和SGLang/vLLM迅速在發布當天提供了推論支援。

**Kimi K2.6 持續引領關注與部署**:@Kimi_Moonshot表示,Kimi K2.6現已在OpenRouter的每週排行榜上名列第一。次級報告將其描述為適用於程式編碼和長週期代理的模型,包括可擴展至300個並行子代理,執行4,000個協調步驟。實踐者對於速度/品質的權衡仍有不同看法:@teortaxesTex發現Kimi在Hermes中比DeepSeek V4慢得多,但有時能修復V4無法解決的錯誤。

**中國模型趨勢概覽**:多篇貼文指出,中國實驗室正積極推動半開源、以代理為導向、長上下文系統的發展:包括Qwen 3.6 Flash、DeepSeek V4/Flash、GLM-5.1的推廣(三倍使用量擴展),以及小米的MIT開源發布。一個重複出現的主題是,較小/較便宜的版本在實際代理基準測試中,往往表現優於其較大的同類模型。

**代理執行環境、協調**

標籤

圖像生成通用人工智慧多模態AIOpenAI開源模型代理模型

以上為 AI 自動翻譯導讀。原文版權歸 Latent Space 所有。 建議透過上方「閱讀原文」前往原始網站,以取得最完整資訊與支持原作者。