研究

解決「打地鼠困境」:AI 視覺模型去偏見新策略

摘要

麻省理工學院研究人員提出名為 WRING 的新型去偏見技術,旨在解決 AI 視覺模型中常見的「打地鼠困境」。現有方法在消除某種偏見時,常會無意中產生或放大其他偏見,而 WRING 透過旋轉模型高維空間中的特定座標,能在不影響其他關係的情況下去除偏見。這項後處理方法高效且侵入性低,有望提升 AI 模型在醫療等高風險應用中的公平性與安全性。

如今在醫院和診所中,皮膚科醫生可能會使用人工智慧模型來分類皮膚病變,以評估病變是否有可能發展成癌症或是否為良性。然而,如果模型對某些膚色存在偏見,它可能就無法識別出高風險患者。

偏見或許是 AI 研究持續面臨的最著名且最頑固的挑戰之一。偏見通常與訓練資料相關,但模型架構本身也可能包含並放大偏見,對模型在實際應用中的表現產生負面影響。在醫療等高風險情境中,糟糕表現的真實後果使得偏見成為一個關鍵的安全問題。

麻省理工學院、伍斯特理工學院和 Google 的研究人員發表了一篇新論文,該論文已被 2026 年國際學習表徵會議(International Conference for Learning Representations)接受,提出了一種名為「加權旋轉去偏見」(Weighted Rotational DebiasING,簡稱 WRING)的新型去偏見方法,可應用於視覺語言模型(VLMs),例如 OpenAI 的 OpenCLIP。

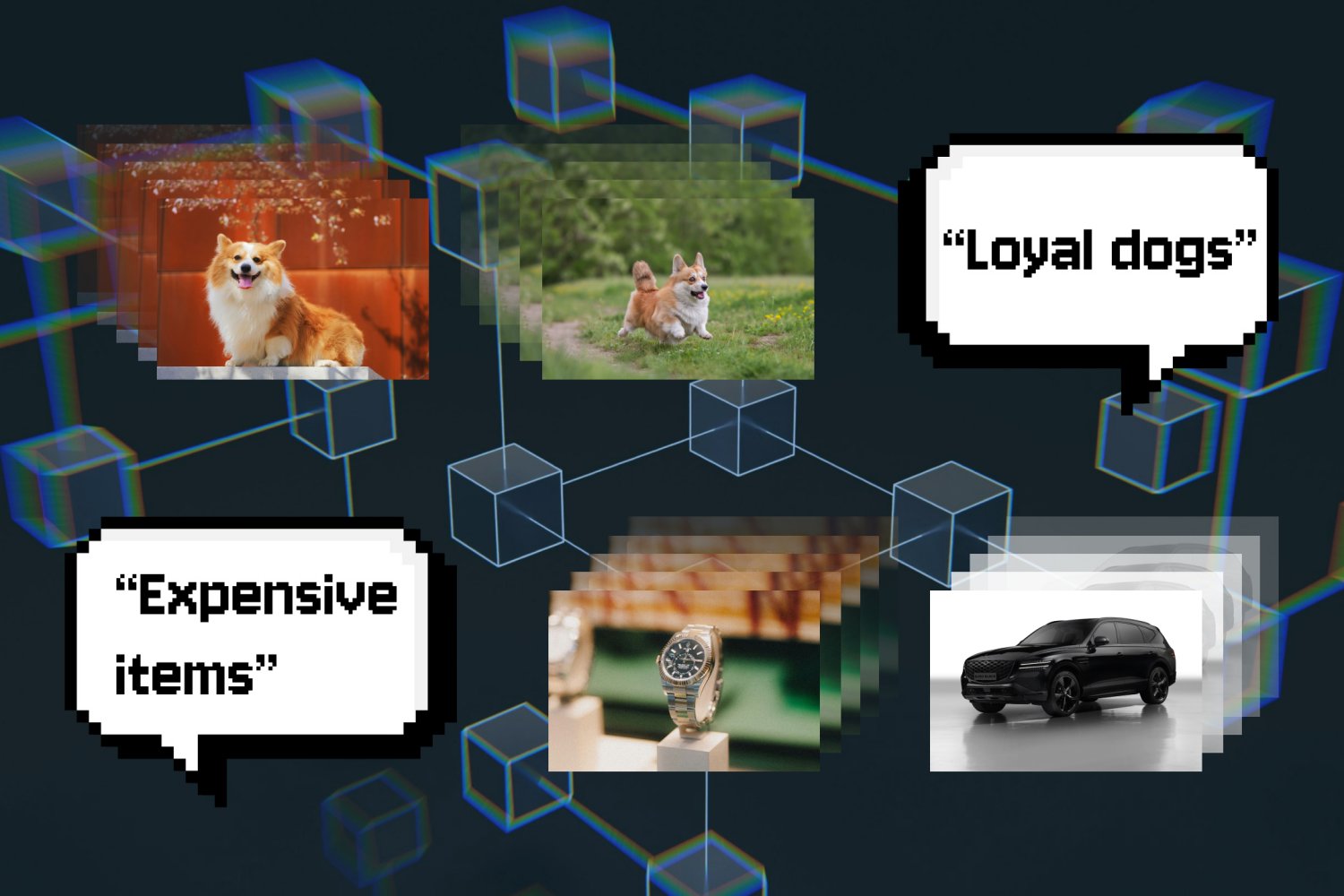

VLMs 是多模態模型,能夠同時理解和解釋視訊、圖像和文字等不同資料模態。儘管目前已有針對 VLMs 的去偏見方法,但最常用的是「投影去偏見」,它導致了所謂的「打地鼠困境」,這是一個在 2023 年正式引入 AI 研究的實證觀察。

投影去偏見是一種後處理方法,它透過將子空間「投影」出關係的表徵空間,從而從模型嵌入中移除不必要的、有偏見的資訊,以此消除偏見。然而,這種方法有其缺點。

該論文的第一作者 Walter Gerych 表示:「當你這樣做時,你會無意中擠壓周圍的一切。模型學到的所有其他關係都會因此而改變。」Gerych 去年在麻省理工學院擔任博士後研究員時進行了這項研究。

Gerych 目前是伍斯特理工學院的電腦科學助理教授,與他共同撰寫論文的還有麻省理工學院研究生 Cassandra Parent 和 Quinn Perian;Google 的 Rafiya Javed;以及麻省理工學院電機工程副教授 Justin Solomon 和 Marzyeh Ghassemi。Ghassemi 也是 Abdul Latif Jameel 機器學習健康診所和資訊與決策系統實驗室的成員。

雖然投影去偏見能阻止模型根據已從子空間中投影出的偏見行事,但它最終可能會放大並產生其他偏見,這就是「打地鼠困境」。Ghassemi 表示,模型偏見的意外放大「既是技術挑戰,也是實際挑戰。例如,當對一個檢索臨床工作人員圖像的 VLM 進行去偏見時,如果消除了種族偏見,卻可能無意中放大性別偏見。」

WRING 的運作方式是將模型高維空間中某些似乎導致偏見的座標,移動到不同的角度,這樣模型就無法再區分特定概念內的不同群體。這改變了特定空間內的表徵,同時保持了模型的其他關係不受影響。與投影去偏見一樣,WRING 也是一種後處理方法,這意味著它可以「即時」應用於預訓練的 VLM。

Gerych 解釋說:「人們已經花費大量資源和金錢來訓練這些龐大模型,我們不希望在訓練過程中進行修改,因為那樣就必須從頭開始。WRING 非常高效,它不需要對模型進行額外訓練,而且侵入性極小。」

在他們的研究結果中,研究人員發現 WRING 顯著減少了目標概念的偏見,而沒有增加其他領域的偏見。但目前,這種方法在某種程度上僅限於對比語言-圖像預訓練(CLIP)模型,這是一種將圖像與語言連接起來進行搜尋或分類的 VLM。

Gerych 表示:「將此方法擴展到 ChatGPT 風格的生成式語言模型,是我們合理的下一步。」

這項工作部分得到了美國國家科學基金會 CAREER 獎、AI2050 獎早期職業獎學金、史隆研究員獎、戈登與貝蒂摩爾基金會獎以及麻省理工學院-Google 計算創新獎的支持。

標籤

AI 偏見視覺語言模型去偏見技術機器學習MIT 研究模型公平性

以上為 AI 自動翻譯導讀。原文版權歸 MIT News (AI) 所有。 建議透過上方「閱讀原文」前往原始網站,以取得最完整資訊與支持原作者。