研究

DeepSeek-V4:百萬級上下文智慧的系統性突破

摘要

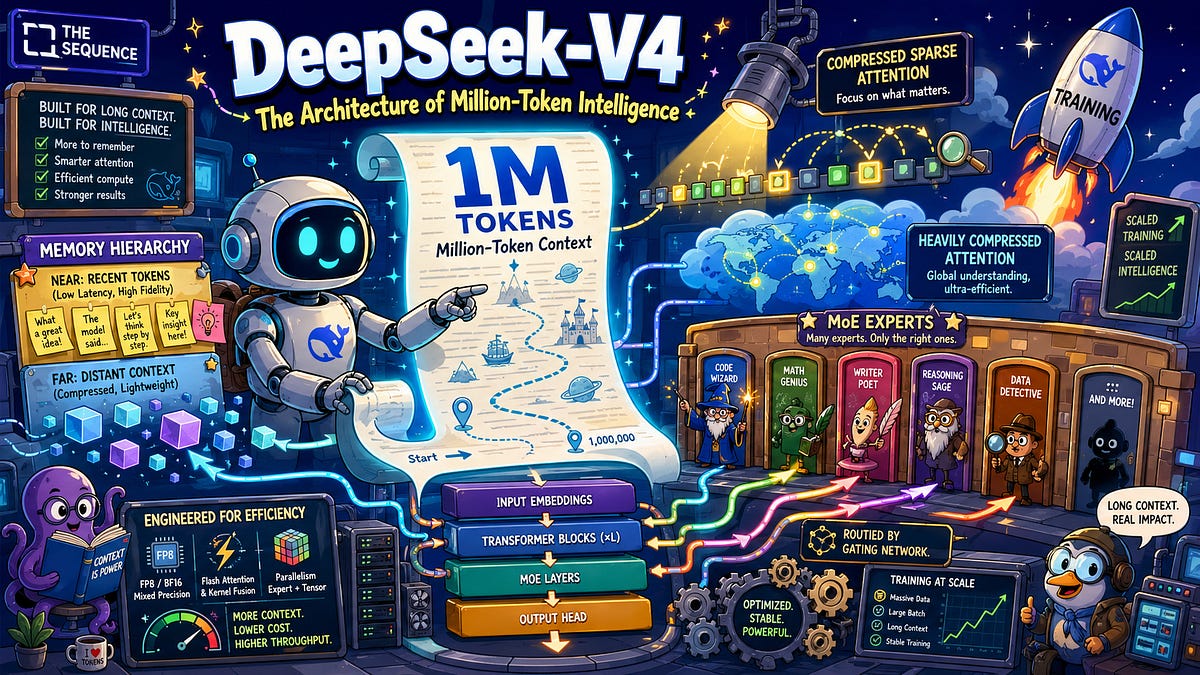

DeepSeek-V4 模型正式發布,支援高達百萬 token 的上下文視窗,但其真正的創新在於如何經濟且實用地運用如此龐大的資訊。這不僅是一個前沿模型,更是一項關於使長上下文推理變得實用的系統性研究,解決了多項技術挑戰。

DeepSeek 的發布總是備受關注。上週,其 v4 版本正式亮相。

DeepSeek-V4 最引人注目的地方,並非它支援百萬 token 的上下文視窗。這個數字固然令人印象深刻,但單純的上下文長度並非衡量智慧的良好指標。一個模型即使能接受百萬個 token,仍可能無法有效利用它們。它可能在 KV 快取中「溺水」、提取錯誤的證據、失去對局部語法的追蹤、因壓縮記憶而產生幻覺,或者將整個提示詞變成模糊的統計雜燴。

真正的問題不是:模型能「攝取」多少文本?

真正的問題是:模型能「經濟地」利用多少歷史資訊?

DeepSeek-V4 正是這個問題的最佳解答。它不僅僅是另一個前沿模型發布,更像是一篇關於如何使長上下文推理變得實用的系統性論文。該模型圍繞著一個簡單卻深刻的前提設計:百萬 token 智慧不僅需要擴展 Transformer 架構,它還需要全新的記憶體層次結構、新的注意力機制、新的訓練穩定器、新的最佳化器選擇、新的量化方案,以及一個能在推論經濟效益下實際運作的服務堆疊。

標籤

DeepSeek-V4長上下文大型語言模型AI架構推論優化記憶體管理

以上為 AI 自動翻譯導讀。原文版權歸 The Sequence 所有。 建議透過上方「閱讀原文」前往原始網站,以取得最完整資訊與支持原作者。